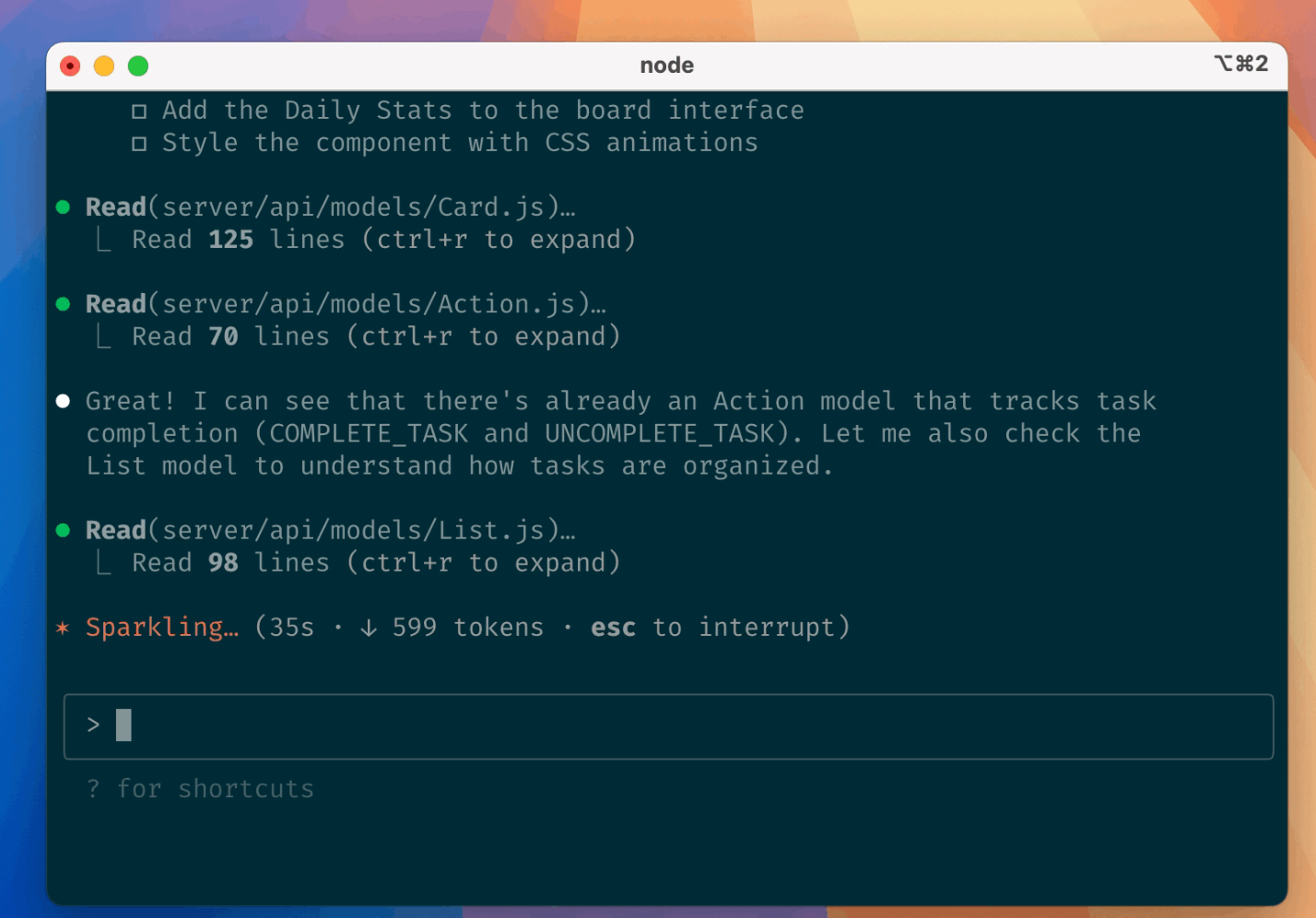

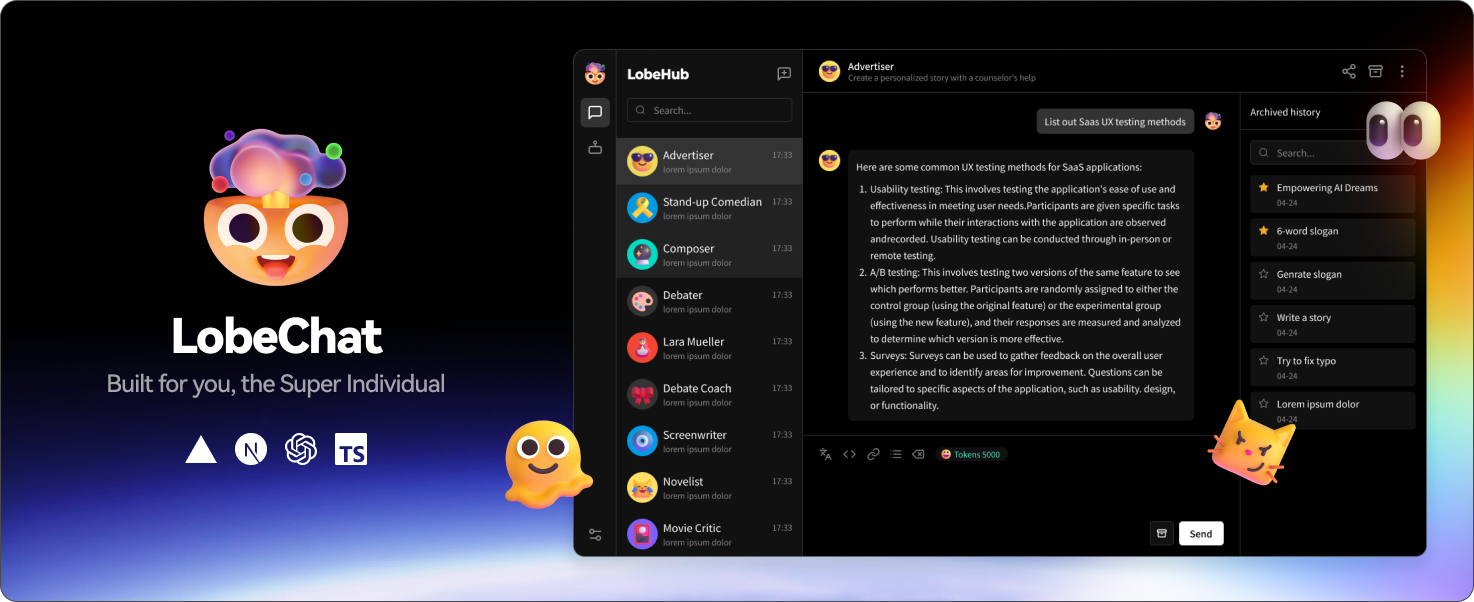

一个开源的、现代设计的 ChatGPT/LLMs UI/框架。支持语音合成、多模态和可扩展插件系统。一键免费部署您的私人 OpenAI ChatGPT/Claude/Gemini/Groq/Ollama 聊天应用程序。

主要功能

1 思路链

体验前所未有的 AI 推理。通过我们创新的思维链 (CoT) 可视化,观看复杂问题逐步展开。这项突破性功能为 AI 的决策过程提供了前所未有的透明度,使您能够实时观察结论是如何得出的。

通过将复杂的推理分解为清晰、合乎逻辑的步骤,您可以更好地理解和验证 AI 的问题解决方法。无论您是在调试、学习,还是只是对 AI 推理感到好奇,CoT 可视化都能将抽象思维转化为引人入胜的交互式体验。

2 分支对话

引入一种更自然、更灵活的 AI 聊天方式。使用 Branch Conversations,您的讨论可以向多个方向流动,就像人类对话一样。从任何消息创建新的对话分支,让您可以自由探索不同的路径,同时保留原始上下文。

在两种强大的模式之间进行选择:

- 延续模式:无缝扩展您当前的讨论,同时保持有价值的背景信息

- 独立模式:根据之前的任何消息从新主题重新开始

这一开创性功能将线性对话转变为动态的树状结构,从而能够更深入地探索想法和更高效的交互。

3 Artifacts 支持

体验 Claude Artifacts 的强大功能,现已集成到 LobeChat 中。这一革命性功能扩展了 AI 与人类交互的界限,实现了各种内容格式的实时创建和可视化。

以前所未有的灵活性进行创建和可视化:

- 生成和显示动态 SVG 图形

- 实时构建和呈现交互式 HTML 页面

- 制作多种格式的专业文档

4 文件上传 /知识库

LobeChat 支持文件上传和知识库功能。您可以上传各种类型的文件,包括文档、图像、音频和视频,以及创建知识库,方便用户管理和搜索文件。此外,您可以在对话期间利用文件和知识库功能,从而获得更丰富的对话体验。

5 多模式服务提供商支持

在 LobeChat 的持续发展中,我们深刻理解模型服务提供商的多样性对于在提供 AI 对话服务时满足社区需求的重要性。因此,我们已将支持扩展到多个模型服务提供商,而不是局限于单个模型服务提供商,以便为用户提供更多样化、更丰富的对话选择。

通过这种方式,LobeChat 可以更灵活地适应不同用户的需求,同时也为开发者提供了更广泛的选择。

支持的模型服务提供商

我们已实现对以下模型服务提供商的支持:

-

OpenAI:OpenAI 是人工智能研究领域的全球领导者,其 GPT 系列等模型推动了自然语言处理的前沿。OpenAI 致力于通过创新和高效的 AI 解决方案改变多个行业。他们的产品表现出卓越的性能和成本效益,广泛用于研究、商业和创新应用。

-

Ollama:Ollama 提供的模型涵盖代码生成、数学运算、多语言处理、对话交互等广泛领域,满足多样化的企业级和本地化部署需求。

-

Anthropic:Anthropic 是一家专注于 AI 研发的公司,提供一系列高级语言模型,例如 Claude 3.5 Sonnet、Claude 3 Sonnet、Claude 3 Opus 和 Claude 3 Haiku。这些模型在智能、速度和成本之间实现了理想的平衡,适用于从企业工作负载到快速响应场景的各种应用程序。Claude 3.5 Sonnet 作为他们的最新型号,在保持高性价比的同时,在多次评估中表现出色。

-

Bedrock:Bedrock 是 Amazon AWS 提供的一项服务,专注于为企业提供高级 AI 语言和视觉模型。其型号系列包括 Anthropic 的 Claude 系列、Meta 的 Llama 3.1 系列等,提供从轻量级到高性能的一系列选项,为不同规模和需求的企业提供文本生成、对话和图像处理等任务。

-

Google:Google 的 Gemini 系列代表了其最先进的多功能 AI 模型,由 Google DeepMind 开发,专为多模态功能而设计,支持对文本、代码、图像、音频和视频的无缝理解和处理。它适用于从数据中心到移动设备的各种环境,显著提高了 AI 模型的效率和适用性。

-

DeepSeek:DeepSeek 是一家专注于 AI 技术研究和应用的公司,其最新型号 DeepSeek-V2.5 集成了通用对话和代码处理能力,在人类偏好对齐、编写任务和指令遵循方面实现了显著改进。

-

PPIO:PPIO 支持稳定且经济高效的开源 LLM API,例如 DeepSeek、Llama、Qwen 等。

-

HuggingFace:HuggingFace 推理 API 为您提供了一种快速免费的方式来探索用于各种任务的数千个模型。无论您是为新应用程序进行原型设计,还是试验机器学习的功能,此 API 都可以让您即时访问跨多个领域的高性能模型。

-

OpenRouter:OpenRouter 是一个服务平台,提供接入各种前沿大模型接口,支持 OpenAI、Anthropic、LLaMA 等,适合多样化的开发和应用需求。用户可以根据自己的需求灵活选择最优的模型和定价,从而增强 AI 体验。

-

Cloudflare Workers AI:在 Cloudflare 的全球网络上运行无服务器 GPU 驱动的机器学习模型。

-

更多的提供商:

- GitHub:借助 GitHub Models,开发人员可以成为 AI 工程师并利用行业领先的 AI 模型。

- Novita:Novita AI 是一个提供各种大型语言模型和 AI 图像生成 API 服务的平台,灵活、可靠、高性价比。它支持 Llama3 和 Mistral 等最新的开源模型,为生成式 AI 应用程序开发提供全面、用户友好且可自动扩展的 API 解决方案,适合 AI 初创公司的快速发展。

- PPIO:PPIO 支持稳定且经济高效的开源 LLM API,例如 DeepSeek、Llama、Qwen 等。

- Together AI:Together AI 致力于通过创新的 AI 模型实现领先的性能,提供广泛的定制功能,包括快速扩展支持和直观的部署流程,以满足各种企业需求。

- Fireworks AI:Fireworks AI 是高级语言模型服务的领先提供商,专注于函数式调用和多模式处理。其最新模型 Firefunction V2 基于 Llama-3,针对函数调用、对话和指令跟踪进行了优化。视觉语言模型 FireLLaVA-13B 支持图像和文本的混合输入。其他值得注意的型号包括 Llama 系列和 Mixtral 系列,提供高效的多语言教学跟随和生成支持。

- Groq:Groq 的 LPU 推理引擎在最新的独立大型语言模型 (LLM) 基准测试中表现出色,以其卓越的速度和效率重新定义了 AI 解决方案的标准。Groq 代表即时推理速度,在基于云的部署中展示了强大的性能。

- Perplexity:Perplexity 是对话生成模型的领先提供商,提供各种支持在线和离线应用程序的高级 Llama 3.1 模型,特别适用于复杂的自然语言处理任务。

- Mistral:Mistral 提供高级通用、专业和研究模型,广泛用于复杂推理、多语言任务和代码生成。通过功能性调用接口,用户可以为特定应用程序集成自定义功能。

- Ai21Labs:AI21 Labs 为企业构建基础模型和 AI 系统,加速生成式 AI 在生产中的应用。

- Upstage:Upstage 专注于开发满足各种业务需求的 AI 模型,包括 Solar LLM 和文档 AI,旨在实现用于工作的通用人工智能 (AGI)。它允许通过 Chat API 创建简单的对话代理,并支持功能调用、翻译、嵌入和特定于领域的应用程序。

- xAI:xAI 是一家致力于构建人工智能以加速人类科学发现的公司。我们的使命是促进我们对宇宙的集体理解。

- Qwen:同义千文是阿里云自主研发的大规模语言模型,具有很强的自然语言理解和生成能力。它可以回答各种问题,创建书面内容,表达观点,编写代码,在多个领域发挥作用。

- 文信:企业级大型模型和 AI 原生应用开发与服务的一站式平台,为生成式人工智能模型开发和应用开发的全流程提供最全面、最人性化的工具链。

- 浑源:腾讯自研的大型语言模型,具备强大的中文创作能力、复杂情境下的逻辑推理能力、可靠的任务执行能力。

- 智谱:智谱 AI 为多模态和语言模型提供了一个开放的平台,支持广泛的 AI 应用场景,包括文本处理、图像理解和编程辅助。

- SiliconCloud:SiliconFlow 致力于加速 AGI 以造福人类,通过易于使用且具有成本效益的 GenAI 堆栈提高大规模 AI 效率。

- 01.AI:01.AI 专注于AI 2.0时代技术,大力推动“人+人工智能”的创新应用,利用强大的模型和先进的AI技术提升人类生产力,实现科技赋能。

- Spark:科大讯飞的 Spark 模型提供跨多领域和多语言的强大 AI 能力,利用先进的自然语言处理技术构建适用于智能硬件、智能医疗、智能金融等垂直场景的创新应用。

- SenseNova:SenseNova 以商汤科技强大的基础设施为后盾,提供高效且用户友好的全栈式大型模型服务。

- Stepfun:StepFun 的大模型拥有业界领先的多模态和复杂推理能力,支持超长文本理解和强大的自主调度搜索引擎功能。

- Moonshot:Moonshot 是由北京暗面科技有限公司推出的开源平台,为各种自然语言处理模型提供广泛的应用,包括但不限于内容创作、学术研究、智能推荐、医学诊断等,支持长文本处理和复杂的生成任务。

- 百川:百川智能是一家专注于大型 AI 模型研发的公司,其模型在国内知识百科、长文本处理、中文生成式创作任务方面表现出色,超越国外主流模型。百川智能还拥有行业领先的多模态能力,在多个权威测评中表现优异。其型号包括百川 4、百川 3 Turbo 和百川 3 Turbo 128k,分别针对不同的应用场景进行了优化,提供高性价比的解决方案。

- Minimax:MiniMax 是一家成立于 2021 年的通用人工智能科技公司,致力于与用户共创智能。MiniMax 自主研发了万亿参数 MoE 文本模型、语音模型、图像模型等不同模态的通用大型模型,并推出了 Conch AI 等应用。

- InternLM:一个致力于大型模型工具链研究和开发的开源组织。它为所有 AI 开发人员提供了一个高效且用户友好的开源平台,使尖端的大型模型和算法技术易于访问。

- Higress:Higress 是阿里巴巴内部开发的云原生 API 网关,用于解决 Tengine 重载影响长链,以及 gRPC/Dubbo 负载均衡能力不足的问题。

- Gitee AI:Gitee AI 的 Serverless API 为 AI 开发人员提供了开箱即用的大模型推理 API 服务。

- 台初:中科院自动化研究所、武汉人工智能研究院推出新一代多模态大模型,支持多轮答疑、文字创作、图像生成、3D理解、信号分析等综合问答任务,具有更强的认知、理解、创造能力,提供全新的交互体验。

- 360 AI:360 AI 是 360 公司推出的 AI 模型和服务平台,提供各种先进的自然语言处理模型,包括 360GPT2 Pro、360GPT Pro、360GPT Turbo 和 360GPT Turbo Responsibility 8K。这些模型结合了大规模参数和多模态功能,广泛应用于文本生成、语义理解、对话系统和代码生成。360 AI 通过灵活的定价策略,满足多样化的用户需求,支持开发者集成,推动智能应用的创新发展。

- Search1API:Search1API 提供对 DeepSeek 系列模型的访问,这些模型可以根据需要连接到 Internet,包括标准和快速版本,支持各种模型大小。

- InfiniAI:为应用开发者提供高性能、易用、安全的大模型服务,覆盖从大模型开发到服务部署的全流程。

- 七牛云:七牛云作为一家历史悠久的云服务提供商,为实时和批处理提供经济高效且可靠的 AI 推理服务,并提供简单且用户友好的体验。

6 本地大型语言模型 (LLM) 支持

为了满足用户的特定需求,LobeChat 还支持使用基于 Ollama 的本地模型,允许用户灵活使用自己的或第三方的模型。

7 模型视觉识别

LobeChat 现在支持 OpenAI 最新的具有视觉识别功能的 gpt-4-vision 模型, 一种可以感知视觉效果的多模态智能。用户可以轻松上传或将图像拖放到对话框中, 代理将能够识别图像的内容并在此基础上进行智能对话, 创建更智能、更多样化的聊天场景。

此功能开辟了新的交互方法,允许通信超越文本并包含丰富的视觉元素。 无论是在日常使用中共享图像,还是在特定行业内解释图像,代理都能提供出色的对话体验。

8 TTS & STT 语音对话

LobeChat 支持文本转语音 (TTS) 和语音转文本 (STT) 技术,使我们的应用程序能够将文本消息转换为清晰的语音输出。 允许用户与我们的对话代理进行交互,就像他们正在与真人交谈一样。用户可以从各种语音中进行选择以与代理配对。

此外,TTS 为那些喜欢听觉学习或希望在忙碌时接收信息的人提供了出色的解决方案。 在 LobeChat 中,我们精心挑选了一系列高质量的语音选项(OpenAI Audio、Microsoft Edge Speech),以满足来自不同地区和文化背景的用户的需求。 用户可以选择适合自己个人喜好或特定场景的语音,从而获得个性化的通信体验。

9 文本到图像生成

通过支持最新的文本到图像生成技术,LobeChat 现在允许用户在与代理的对话中直接调用图像创建工具。通过利用 DALL-E 3、MidJourney 和 Pollinations 等 AI 工具的功能,代理现在可以将您的想法转化为图像。

这实现了更加私密和身临其境的创作过程,允许将视觉叙事无缝整合到您与经纪人的个人对话中。

10 插件系统(函数调用)

LobeChat 的插件生态是其核心功能的重要延伸,大大增强了 LobeChat 助手的实用性和灵活性。

通过使用插件,LobeChat 助手可以获取和处理实时信息,例如搜索网络信息和为用户提供即时和相关新闻。

此外,这些插件不仅限于新闻聚合,还可以扩展到其他实用功能,例如快速搜索文档、生成图像、从 Bilibili、Steam 等各种平台获取数据,以及与各种第三方服务交互。

11 代理市场 (GPT)

在 LobeChat Agent Marketplace 中,创作者可以发现一个充满活力和创新的社区,该社区汇集了众多精心设计的代理, 不仅在工作场景中发挥着重要作用,而且在学习过程中也提供了极大的便利。 我们的市场不仅是一个展示平台,也是一个协作空间。在这里,每个人都可以贡献自己的智慧,分享自己开发的智能体。

12 支持本地/远程数据库

LobeChat 支持使用服务器端和本地数据库。根据您的需求,您可以选择适当的部署解决方案:

- 本地数据库:适合希望更好地控制其数据和隐私保护的用户。LobeChat 使用 CRDT(Conflict-Free Replicated Data Type)技术实现多设备同步。这是一项旨在提供无缝数据同步体验的实验性功能。

- 服务器端数据库:适合希望获得更便捷用户体验的用户。LobeChat 支持将 PostgreSQL 作为服务器端数据库。有关如何配置服务器端数据库的详细文档,请访问配置服务器端数据库。

13 支持多用户管理

LobeChat 支持多用户管理,并提供两种主要的用户认证和管理解决方案,以满足不同的需求:

- next-auth:LobeChat 集成,一个灵活而强大的身份验证库,支持多种身份验证方式,包括 OAuth、邮件登录、凭证登录等。有了 ,您可以轻松实现用户注册、登录、会话管理、社交登录等功能,确保用户数据的安全性和隐私性。

next-authnext-auth - Clerk:对于需要更高级用户管理功能的用户,LobeChat 还支持现代用户管理平台。 提供更丰富的功能,例如多因素身份验证 (MFA)、用户配置文件管理、登录活动监控等。有了 ,您可以获得更高的安全性和灵活性,轻松应对复杂的用户管理需求。

ClerkClerkClerk

14 渐进式 Web 应用程序 (PWA)

我们深刻理解在当今多设备环境中为用户提供无缝体验的重要性。 因此,我们采用了渐进式 Web 应用程序 (PWA) 技术, 一种现代 Web 技术,可将 Web 应用程序提升到接近本机应用程序的体验。

通过 PWA,LobeChat 可以在桌面和移动设备上提供高度优化的用户体验,同时保持其轻量级和高性能特性。 在视觉和感觉方面,我们还精心设计了界面,以确保它与原生应用程序没有区别, 提供流畅的动画、响应式布局,并适应不同的设备屏幕分辨率。

15 移动设备适配

我们对移动设备进行了一系列优化设计,以增强用户的移动体验。目前,我们正在迭代移动用户体验,以实现更流畅、更直观的交互。如果您有任何建议或想法,我们欢迎您通过 GitHub Issues 或 Pull Requests 提供反馈。

16 自定义主题

作为一个以设计工程为导向的应用程序,LobeChat 非常重视用户的个性化体验, 因此引入了灵活多样的主题模式,包括白天的浅色模式和夜间的深色模式。 除了切换主题模式之外,一系列颜色自定义选项还允许用户根据自己的喜好调整应用程序的主题颜色。 无论是对清醒的深蓝色、活泼的桃粉色,还是专业的灰白色,用户都可以在 LobeChat 中找到自己的颜色选择风格。

安装和使用

LobeChat 通过 Vercel、阿里云和 Docker Image 提供自托管版本。这使您可以在几分钟内部署自己的聊天机器人,而无需任何先验知识。

提示

通过查看了解有关📘构建您自己的 LobeChat 的更多信息。

A使用 Vercel、Zeabur、Sealos 或阿里云进行部署

“如果您想在 Vercel、Zeabur 或阿里云上自行部署此服务,您可以按照以下步骤作:

- 准备您的 OpenAI API 密钥。

- 点击下方按钮开始部署:直接使用你的 GitHub 账号登录,记得填写环境变量部分的 (required) 和 (recommended)。

OPENAI_API_KEYACCESS_CODE - 部署后,您可以开始使用它。

- 绑定自定义域名(可选):Vercel 分配的域名 DNS 部分区域受到污染;绑定自定义域可以直接连接。

B使用 Docker 进行部署

我们提供了一个 Docker 镜像,用于在您自己的私有设备上部署 LobeChat 服务。使用以下命令启动 LobeChat 服务:

- 为 Storage Files 创建一个文件夹

$ mkdir lobe-chat-db && cd lobe-chat-db

- 初始化 LobeChat 基础设施

bash <(curl -fsSL https://lobe.li/setup.sh)

- 启动 LobeChat 服务

docker compose up -d

环境变量

该项目提供了一些额外的配置项,设置了环境变量:

| 环境变量 | 必填 | 描述 | 例 |

|---|---|---|---|

OPENAI_API_KEY |

是的 | 这是您在 OpenAI 账户页面上应用的 API 密钥 | sk-xxxxxx...xxxxxx |

OPENAI_PROXY_URL |

不 | 如果手动配置 OpenAI 接口代理,可以使用该配置项覆盖默认的 OpenAI API 请求基 URL | https://api.chatanywhere.cn或 默认值为https://aihubmix.com/v1https://api.openai.com/v1 |

ACCESS_CODE |

不 | 添加密码以访问此服务;您可以设置长密码以避免泄漏。如果此值包含逗号,则它是密码数组。 | awCTe)re_r74或 或rtrt_ewee3@09!code1,code2,code3 |

OPENAI_MODEL_LIST |

不 | 用于控制模型列表。用于添加模型、隐藏模型和自定义模型的显示名称,以逗号分隔。+-model_name=display_name |

qwen-7b-chat,+glm-6b,-gpt-3.5-turbo |

⌨️ 本地开发

您可以使用 GitHub Codespaces 进行在线开发:

https://codespaces.new/lobehub/lobe-chat

或者克隆它以进行本地开发:

$ git clone https://github.com/lobehub/lobe-chat.git

$ cd lobe-chat

$ pnpm install

$ pnpm dev

如果您想了解更多详细信息,请随时查看我们的📘开发指南。